説明可能なAI

大規模言語モデルを含むニューラルネットワークは、その ブラックボックス性 が批判されることがあります。ニューラルネットワークのブラックボックス性とは、入力から出力に至るモデル(ニューラルネットワーク)の内部機序が明らかではないことを指しています。ニューラルネットワークの中ではおびたたしい数の計算がされていますが、数が多すぎてそれぞれが何を表しているかわかりません。このため、入力と出力の間で何が起こっているのかを明らかにすることができないのです。特に医療分野などのように、出力が重大なリスクにつながるような応用では、なぜその判断をしたのかを説明できることが必要になります。「説明可能なAI」は、特にニューラルネットワークの内部機序を明らかにすることを目的とする研究領域です。当研究室では、長く主流となっているポストホックなアプローチ(ニューラルネットワークの学習後に後付けする方法)ではなく、ニューラルネットワーク自体に解釈可能性を持たせて学習する方法について研究を進めています。

概念を自動的に特定する説明可能な識別器

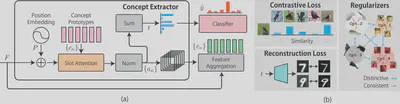

深層ニューラルネットワークの振る舞いを解釈し、説明することは、多くのタスクにおいて極めて重要です。説明可能AIは、この課題に対処する方法を提供しており、主として各画素が意思決定にどの程度寄与したかを示すことで説明を行います。しかし、そのような説明を解釈するには、専門的な知識を要する場合があります。近年では、解釈可能性の向上に向けた試みとして、概念ベースの枠組みを採用し、いくつかの概念とモデルの意思決定との間に、より高次の関係を与える研究も現れています。本論文では、Bottleneck Concept Learner(BotCL)を提案します。BotCL は、概念に対する明示的な教師あり情報を用いることなく、対象タスクに対する学習を通じて獲得された概念の有無のみによって画像を表現します。また、自己教師あり学習と専用の正則化項を用いることで、獲得された概念が人間にとって理解しやすいものとなるようにしています。画像分類タスクを実験対象として用い、BotCL がニューラルネットワークをより高い解釈可能性を持つ形へ再構築する可能性を示します。

コードはこちら。

スロットアテンションによる説明可能な識別器

説明可能なAIの多くの手法は、既存の手法の多くは勾配や中間特徴に基づいており、これらは識別器の意思決定過程に直接関与しているわけではありません。本論文では、透明性と高い分類精度を両立する、スロットアテンションに基づく分類器 SCOUTER を提案します。他のアテンションベース手法との主な違いは2点あります。 (a) SCOUTER の説明は各カテゴリの最終的な信頼度に関与しており、より直感的な解釈を可能にすること、 (b) すべてのカテゴリに対して、それぞれ対応する肯定的または否定的な説明が与えられることです。これにより、「なぜその画像があるカテゴリに属するのか」あるいは「なぜその画像があるカテゴリに属さないのか」を示すことができます。 さらに、SCOUTER のために新しい損失関数を設計し、肯定的説明と否定的説明の切り替えや、説明領域の大きさを制御できるようにしました。実験結果から、SCOUTER は小規模および中規模のデータセットにおいて、高い精度を維持しながら、さまざまな評価指標の面でより優れた視覚的説明を与えられることが示されています。

コード等はこちら。